Система за разпознаване на лица успя да „види" нереален човек

- Роботика, автоматизация, компютри

- Източник: internetua.com

- Автор:

Снимка: https://cursodebaba.com

Снимка: https://cursodebaba.com

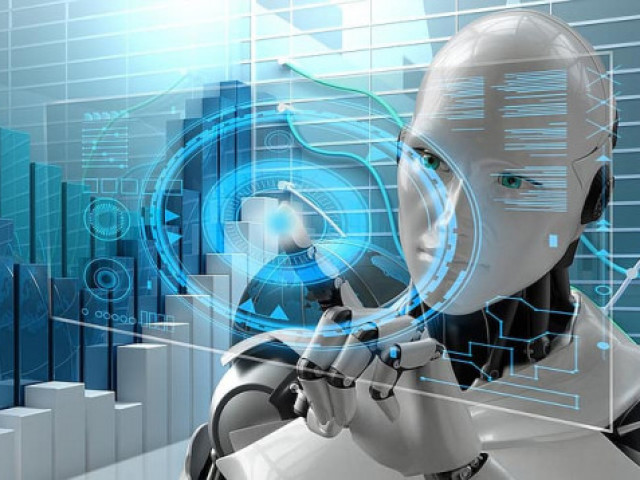

Специалистите на компанията McAfee демонстрираха как злосторници могат да заблудят съвременните системи за разпознаване на лица, като ги накарат да „видят" човек на снимка, на която всъщност го няма.

В хода на изследването специалистите осъществиха атака срещу система за разпознаване на лица, подобна на тази, използвана на летищата за проверка на паспортите. С помощта на машинно обучение (изкуствения интелект) те създадоха изображение на лице, което за човешкото око изглежда като един човек, но за системата за разпознаване на лица - като съвсем друг. Според експерти, благодарение на този трик престъпници, на които е забранено да използват въздушен транспорт, могат без проблем да си купят самолетен билет.

За да заблудят алгоритъма, изследователите използват генеративно-състезателна мрежа CycleGAN, способна да трансформира снимки от един стил в друг. Например тя може да направи снимката на залив да изглежда така, сякаш е картина на художника Клод Моне, или снимка на планините през лятото да изглежда така, сякаш е направена през зимата.

Екипът на McAfee „захрани" мрежата CycleGAN с 1,5 хиляди снимки на двамата ръководители на изследването, за да превърне образа на единия ръководител в другия. Снимките, генерирани от CycleGAN, са въведени в системата за разпознаване на лица, за да се провери дали тя може да разпознае изобразения на тях човек. Генерирайки стотици изображения, CycleGAN в крайна сметка избра снимката на човек, който за невъоръженото око изглежда като единия ръководител, но се разпознава от системата като друг човек.

Въпреки че изследването на специалистите поражда опасения относно надеждността на системите за разпознаване на лица, има няколко „но".

Първо, изследователите не са имали достъп до истинската система за разпознаване, използвана на летищата, а вместо това им се е наложило да се възползват от алгоритъм с отворен изходен код. Според тях липсата на достъп до истинската система се явява най-сложният от всички проблеми, с които ще се наложи да се сблъскат злосторници, искащи да измамят алгоритъма.

Второ, в момента подобна атака изисква много ресурси и време.

Според специалистите от McAfee целта на тяхното изследване е преди всичко да направят демонстрация на уязвимостта на системите, базиращи се на технологии за изкуствен интелект, доказваща, че все още не може да се разчита на изкуствения интелект и че реалните сътрудници на летищата засега си остават незаменими при проверките на пътниците.

Още по темата във

facebookСподели тази статия в:

Богатите са укрили от данъчните власти над $ 3.5 трилиона

Какво каза Тръмп на американците и какво означават думите му

Първият танкер за превоз на втечнен природен газ навлезе в Ормузкия проток

Гръцки депутати обвинени в мащабна злоупотреба със селскостопански субсидии

Криптомайнерът Bitdeer ще изгради най-големия в Норвегия център за данни за ИИ

Тръмп обмисля изтегляне на САЩ от НАТО

Какво донесе на икономиките войната в Близкия изток

Цените на петрола падат, акциите скачат